情報量

| 情報理論 |

|---|

|

| 情報量 |

| 通信路 |

| 単位 |

| その他 |

|

|

情報量(じょうほうりょう)やエントロピー(英: entropy)は、情報理論の概念で、あるできごと(事象)が起きた際、それがどれほど起こりにくいかを表す尺度である。ありふれたできごと(たとえば「風の音」)が起こったことを知ってもそれはたいした「情報」にはならないが、逆に珍しいできごと(たとえば「曲の演奏」)が起これば、それはより多くの「情報」を含んでいると考えられる。情報量はそのできごとが本質的にどの程度の情報を持つかの尺度であるとみなすこともできる。

なおここでいう「情報」とは、あくまでそのできごとの起こりにくさ(確率)だけによって決まる数学的な量でしかなく、個人・社会における有用性とは無関係である。たとえば「自分が宝くじに当たった」と「見知らぬAさんが宝くじに当たった」は、前者の方が有用な情報に見えるが、両者の情報量は全く同じである(宝くじが当たる確率は所与条件一定のもとでは誰でも同じであるため)。

自己情報量(自己エントロピー)と平均情報量(エントロピー)

[編集]それぞれのできごとの情報量だけでなく、それらのできごとの情報量の平均値も情報量と呼ぶ。両者を区別する場合には、前者を自己情報量(自己エントロピーとも)、後者を平均情報量(エントロピーとも)と呼ぶ。

自己情報量

[編集]事象 が起こる確率を とするとき、事象 が起こったことを知らされたとき受け取る自己情報量 は、以下で定義される:

確率は なので自己情報量 は非負である。また対数の単調増加性により、起こりにくい事象(=生起確率が低い事象)の情報量ほど値が大きい。

対数の底として何を選んでも情報量の値が定数倍変わるだけなので本質的な差はない。慣習的に底に2を選ぶことが多い。底が2の場合、 の確率で起こる事象の情報量は である。

直観的意味

[編集]整数に対し、の対数は進法でのの桁数にほぼ等しい値を表す。したがって、確率で起こる事象の情報量は、ほぼの桁数になる。

情報量の加法性

[編集]情報量は加法性を持つ。すなわち独立な事象AとBに対し、事象「AもBも起こる」の情報量は、Aの情報量とBの情報量の和である。これは以下で証明される。

例えば、52枚のトランプから無作為に1枚を取り出すという試行を考える。「取り出したカードはハートの4である」という事象の情報量は、前述の定義から log 52 であると分かる。ここで、「取り出したカードのスートはハートである」という事象と「取り出したカードの数字は4である」という事象の二つを考えると、前者の情報量は log 4、後者は log 13 である。この両者の和は log 4 + log 13 = log (4×13) = log 52 となり、「取り出したカードはハートの4である」という事象の情報量と等しい。これは「独立した情報の和が、全体の情報量と一致する」という直感的要請に合致する。

導出

[編集]情報量に対する直感的要請には「発生確率が低いほど大きく(単調減少性)」「確率に関して連続的に変化し(連続性)」「独立同時事象の情報量が周辺事象の情報量和に等しい(加法性)」の三条件が挙げられる。この3条件を満たす関数はコーシーの函数方程式を利用することでと一意に求まる。よって情報量の定義は上記の3条件から一意に導出できる。典型的には対数の底を2としてp=1/2で1となるようにCを設定(C=-1)する。

平均情報量(エントロピー)

[編集]を確率空間とする。全事象 Ω の分割 が与えられたとき[2]、各事象 の自己情報量 で定義した値

を確率測度 P のエントロピー H(P) と呼ぶ(平均情報量、シャノン情報量、情報論のエントロピーとも)。ただし、ここで のときは、 とみなす。これは であることによる。

また、離散型確率変数 X が確率分布 P に従う場合には、 X のエントロピー H(X) を自己情報量 I の期待値によって定義する。すなわち、

である[3]。ここで fX は X の確率質量関数である[4]。

より、エントロピーは常に非負である。

確率変数 X と Y の組 (X, Y) も確率変数とみなせる。この確率変数の値の発生確率すなわち同時確率を とすると、 (X, Y) のエントロピー は

になる。これを結合エントロピーと呼ぶ。

(X, Y) が互いに独立な確率変数である場合には、 は に一致する。すなわち、全体の情報量 は、それぞれの確率変数の情報量の和である。

しかし、 X と Y が互いに独立ではない場合は、 と は一致せず、前者より後者の方が大きい値になる。両者の情報量の差を相互情報量と呼び、

で表す。相互情報量は常に非負の値になる。

事象B が生じているという条件下における事象A の条件付き情報量を によって定める。確率変数 X が与えられたとき、事象「」の条件付き情報量 の x に関する加重平均を条件付きエントロピーと言い、

で表す。

さらに確率変数 Y が与えられたとき、事象「」が生じているという条件下における条件付きエントロピーの y に関する加重平均

も、やはり条件付きエントロピーと呼ぶ。

エントロピーの基本的性質

[編集]- 情報量は確率だけによって決まる。

- 情報量は非負の値または無限大を取る。

- nビットのビット列の空間(情報源)から(一様ランダムとは限らない方法で)ランダムにビット列を選んだときのエントロピーは、n以下になる。エントロピーがnになる必要十分条件は、ビット列が一様ランダムに選ばれることである。

- 確率変数XとYが独立である必要十分条件は、が成立することである。

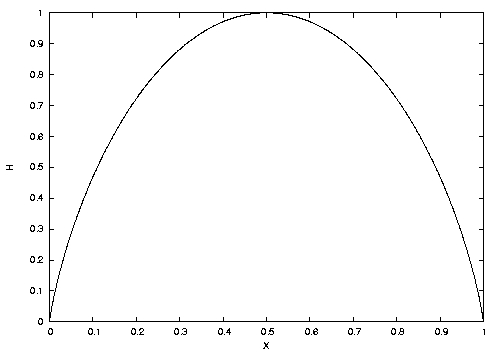

コイン投げの例

[編集]あるコインを投げたときに表が出る確率を 、裏が出る確率を とする。このコインを投げたときに得られる平均情報量(エントロピー)は、

である。

この関数をエントロピー関数と呼ぶ。

図を見ると分かるように、 と では H はゼロである。つまり、コインを投げる前から裏または表が出ることが確実に分かっているときに得られる平均情報量は、ゼロである。 H が最大になるのは のときであり、一般にすべての事象(できごと)が等確率になるときにエントロピーが最大になる。

連続系のエントロピー

[編集]実数値を取る確率変数Xの確率密度関数をp(x)とするとき、Xのエントロピーを

によって定義する。

Xが有限集合に値を取る確率変数である場合には、Xのシャノン情報量も定義できる。Xがn通りの値を取るとき、とは、

を満たす。

ただし、ここではn元集合上の一様分布とする(すなわち)。

Renyiエントロピー

[編集]を、台が有限集合である確率空間とする。Pを上の確率分布とし、を非負の実数とする。

のとき、Pのdegee のRenyiエントロピーを

によって定義する。 また、の場合には、Renyiエントロピーを

によって定義する。

単にRenyiエントロピーと言った場合はを意味することも多い。

さらに、確率変数Xが確率分布Pに従うとき、をによって定義する。

Renyiエントロピーは以下の性質を満たす:

- が成立する。

- はシャノン情報量 と一致する。

- が2以上の整数の場合には、 が成立する。ここで、 は確率分布 に従う独立同一分布であって、 は をそれぞれ に従って選んだときに が成立する確率とする。

- が成立する。この をminエントロピーともいう。

歴史

[編集]「エントロピー」の概念は1865年にルドルフ・クラウジウスがギリシャ語の「変換」を意味する言葉を語源として、熱力学における気体のある状態量として導入した。これは統計力学では微視的な状態数の対数に比例する量として表される。1929年にはレオ・シラードが、気体についての情報を観測者が獲得することと統計力学におけるエントロピーとの間に直接の関係があることを示し、現在 1 ビット(1 シャノン)と呼ぶ量が統計力学で k ln 2 に対応するという関係を導いていた[5]。

現在の情報理論におけるエントロピーの直接の導入は1948年のクロード・シャノンによるもので、その論文『通信の数学的理論』でエントロピーの概念を情報理論に応用した[6]。シャノン自身は熱統計力学でこの概念と関連する概念がすでに使われていることを知らずにこの定義に到達したが、その名称を考えていたとき同僚フォン・ノイマンが、熱統計力学のエントロピーに似ていることから示唆したもので、フォン・ノイマンは「統計エントロピーが何なのかを理解してる人は少ないから、議論になったら有利であろう」と語ったとされる[7][8]。しかしシャノンはフォン・ノイマンとの会話は認めつつその影響を否定している[9]。

なお、シャノン以前にもラルフ・ハートレーが1928年に、集合Aに対してという量を考察している(“”はAの元数)。はA上の一様分布のエントロピーに一致する。現在では、をAのハートレー・エントロピーと呼ぶ[10]。

単位

[編集]情報量は本来無次元の量である。しかし、対数の底として何を用いたかによって値が異なるので,単位を付けて区別している。前述のように、情報量は確率の逆数の桁数の期待値なので、単位も桁数のそれを流用する。この為、対数の底として2、e、10を選んだときの情報量の単位は、それぞれビット(bit)、ナット(nat)、ディット(dit)である。

また、今のところ主流ではないものの、1997年に日本工業規格 JIS X 0016:1997(これは国際規格 ISO/IEC 2382-16:1996と一致している)は、これらの量を表す単位を別に定めている。

| 底 | 通常の単位 | JISおよびISOが定めた単位 | 備考 |

|---|---|---|---|

| 2 | ビット (bit) | シャノン (shannon) | lb, 二進対数 |

| e=2.718… | ナット (nat) | ナット (nat) | ln, 自然対数 |

| 10 | ディット (dit) | ハートレー (hartley) | lg, 常用対数 |

単位「シャノン」、「ハートレー」の名称は、それぞれ情報量の概念を提案したクロード・シャノン、ラルフ・ハートレーにちなむ。

脚注

[編集]- ^ Gray, Robert M. (2013-03-14) (英語). Entropy and Information Theory. Springer Science & Business Media. ISBN 978-1-4757-3982-4

- ^ この分割は離散型確率変数の確率質量関数から誘導されることもある[1]。

- ^ Cover, Thomas M.; Thomas, Joy A. (2012-11-28) (英語). Elements of Information Theory. John Wiley & Sons. ISBN 978-1-118-58577-1

- ^ fX(x) をと書くこともある。

- ^ Szilard, L. (1929) "Über die Entropieverminderung in einem Thermodynamischen System bei Eingriffen Intelligenter Wesen", Zeitschrift für Physik 53:840–856

- ^ Cover & Thomas 2006, Historical Notes.

- ^ 『ファインマン計算機科学』 p. 96 ファインマンによる脚注*8で、「言い伝えによれば」と断りのうえでこの説を紹介している。

- ^ 韓太舜、小林欣吾『情報と符号の数理』

- ^ CLAUDE E. SHANNON: An Interview Conducted by Robert Price, 28 July 1982

- ^ なお、JIS X 0016:1997 で定義される選択情報量(decision content)も同じ定義である。「互いに排反な事象から成る有限集合中の事象の数の対数。」

参考文献

[編集]- Shannon entropy calculator (English)

- A Mathematical Theory of Communication Shannon 1948 (English)

- Cover, Thomas M.; Thomas, Joy A. (2006). Elements of information theory (Second ed.). John Wiley & Sons. ISBN 978-0-471-24195-9. MR2239987

関連項目

[編集]外部リンク

[編集]- 情報量 - 脳科学辞典

- 『情報量の意味と対数関数を使う理由』 - 高校数学の美しい物語

- “JISX0016:1997 情報処理用語(情報理論)”. kikakurui.com. 2023年10月28日閲覧。

![{\displaystyle H(X)=\mathbb {E} _{P}[I(X)]=-\sum _{x\in X}f_{X}(x)\log f_{X}(x)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/df3934e20d3afcc3f3153e97d7ba033210af7fa1)

![{\displaystyle H(X,Y)=\mathbb {E} _{P_{X,Y}}[I(X,Y)]=-\sum _{(x,y)\in (X,Y)}P_{X,Y}(x,y)\log P_{X,Y}(x,y)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/56a1bcb8cf1ab9f462c7646b2f2c8af9706775a0)

![{\displaystyle H(X\mid B)=\mathbb {E} _{P_{X\mid B}}[I(X\mid B)]=-\sum _{x\in X}\Pr(X=x\mid B)\log \Pr(X=x\mid B)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7efcbea13b150101ca042e684f515542306bcba8)