HFACS

HFACS(Human Factors Analysis and Classification System,人間要因分析と分類システム)は、リスクアセスメントの分野において、人的要因(ヒューマンファクター)の事故防止を目的とした分析・分類のフレームワーク(基本構造)である。HFACSにより事故の人的原因を特定し、予防訓練の計画方法としての分析のための手段を提示できる[1]。事故の防止の手法であり、事故原因の解析手法ではない。特定業界のものではなく、航空、医療、運輸、製造などで適用できる。作成タイミングは事故後を想定している。

(出典:wikipedia<Human Factors Analysis and Classification System>,<Human reliability>)

事故防止手法[編集]

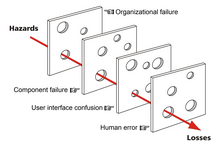

HFACSの基本構成は、ヒューマンエラーの「スイスチーズモデル」に基づいて、4つ以上の異なる種類のバリアで事故防止を図っている。このため、4つのレベルとして、

- 「安全でない行為」

- 「安全でない行為の前提条件」

- 「安全でない監督」

- 「組織の影響」

でヒューマンエラーを調べる[1]。 スイスチーズモデルの思考では、1つのレベルでエラー修正ができれば事故防止になる。

分類[編集]

前述した4つのレベルを分類し分析する。HFACSとしての分類は、ヒューマンエラーの4つのレベル内で原因のカテゴリになる[2]。これらのカテゴリーは、多くの航空事故報告に基づいて経験的に開発された。なお、各レベル間で同じ事項が指摘されることも多々あり、それによりスイスチーズモデルとしての検出ができる。また、この分類は基本形式であり各所で分類が異なる。例えば、発足したアメリカ軍でもHFACSは分類バージョンが複数あり、航空分野でもJ-HFACS(#参考文献 参照)などもある。

安全でない行為[編集]

「安全でない行為」とは、「最前線で」人間のオペレーター(例えば、パイロット、航空管制官、運転手)によって実行される行為のこと。「安全でない行為」は、「エラー(認識、意思決定、またはスキルベースのパフォーマンス)」または「違反(日常的または例外的)」のいずれかである。ここでの「エラー」は、上記の説明と同様である。違反とは、名前の通り、規則や手順を故意に無視することである。「日常的な違反」とは、習慣的に発生し、通常は組織または当局によって許容される違反である。「例外的な違反」は珍しく、しばしば極端である。たとえば、55mphのゾーン速度制限で60mphを運転することは日常的な違反であるが、同じゾーンで130mphを運転することは例外的である。

- エラー

- 認識 - 空間失調、信号機の見間違い、標識の見落とし、逆光による見落とし など

- 意思決定 - 設定ミス、だろう運転 など

- スキル - 新人運転手に難易度の高い列車運行 など

- 違反

- 日常的 - 速度違反の常態化、日常的に点検無視 など

- 例外的 - 遅刻時での速度違反、事故後の点検無視 など

安全でない行為の前提条件[編集]

「安全でない行為の前提条件」には、「人間のオペレーターの内部状態に関連するもの」と、「人間のオペレーターの慣行または作業方法に関連するもの」の2種類がある。有害な「内部状態」には、生理学(例、病気)および精神状態(例、精神的倦怠感、気が散る)に関連するものを含む。「内部状態」の3番目の側面は、実際にはオペレーター能力とタスク要求能力との間の不一致がある。たとえば、オペレーターは視覚的な判断をしたり目前のタスクするのに、十分な速さで反応できない場合がある。不十分なオペレーターの慣行は、不十分な乗組員のリソース管理(リーダーシップやコミュニケーションなどの問題)および不十分な個人的な準備慣行(例えば、航空における乗組員の休憩要件への違反)を含む。

- オペレーターの内部状態

- 生理学的要因 - 病気、低酸素状態 など

- 精神状態 - ストレス、(無理なタイムスケジュールによる)心理的圧迫、(ミスに対し懲罰的作業を課す)心理的圧迫 など

- 精神的・心理的制限、身体的制限 - 視覚的制限(視力不足) など

- 慣行または作業方法、人事要因

- 不適切なクルーリソース管理 - 新人運転手に難易度の高い路線運行 など

- 不十分な個人的準備慣行 - 寝不足、飲酒の影響が残っている場合 など

- 環境要因

- 物理的環境 - 悪天候、逆光 など

- 技術環境 - 安全装置からの不要な警告の多発、危険な場所での安全装置の未実装、見にくい信号 など

安全でない監督[編集]

安全でない監督には、次の4種類がある。

- 不十分/不適切な監督 - ミスに対し懲罰的な日勤教育 など

- 計画された不適切な操作 - 異常なスピードでの侵入の計画、ゆとりのないスケジュール など

- 既知の問題の修正の失敗 - 外部機関から地震津波の指摘に対処しない場合 など

- 監督違反 - 組織的な違反隠し など

組織の影響[編集]

組織の影響には、下記のようなものがある。

- リソース管理(たとえば、不十分な人的または財源) - 安全より利益を重視した費用配分 など

- 組織風土(構造、ポリシー、および文化) - 安全軽視やコンプライアンス違反の常態化 など

- 組織プロセス(手順、スケジュール、監視など) - 安全より利益を重視した余裕のないタイムスケジュール など

歴史[編集]

民間航空医療研究所のスコット・シャペル博士( Dr Scott Shappell )とイリノイ大学アーバナ校のダグ・ウィーグマン博士(Dr Doug Wiegmann )によって、海兵隊と海兵隊のすべての飛行事故の80%の主な原因が、何らかの形のヒューマンエラー(人的失敗)であることが示された[1]。このため、2000年、両氏により人的要素分析と分類システム(HFACS)が、当初、航空事故における「ヒューマンエラー」の役割を理解するためのフレームワークとして開発された[3][4]。HFACSは、ヒューマンエラーの「スイスチーズモデル」[5]に基づいている。なお、スイスチーズモデルは1990年ジェームス・リーズン(James Reason)の研究によるアイデアである。

関連項目[編集]

参考文献[編集]

このページ内では下記文献を引用していない。(転載許可が分からないため)

- 仲村彰, 岡野晃二, 相羽清彦「ヒューマン・ファクター分析技法J-HFACS作成に関する研究」『安全工学』第51巻第4号、安全工学会、2012年8月、241-247頁、doi:10.18943/safety.51.4_241、ISSN 05704480、NAID 10030926343。

- (SKYbrary) Human Factors Analysis and Classification System (HFACS) https://www.skybrary.aero/index.php/Human_Factors_Analysis_and_Classification_System_%28HFACS%29

脚注[編集]

- ^ a b c "The Human Factors Analysis and Classification System (HFACS),"Approach, July - August 2004. Accessed July 12, 2007. Archived February 8, 2007, at the Wayback Machine.

- ^ HFACS Analysis of Military and Civilian Aviation Accidents: A North American Comparison. ISASI, 2004

- ^ Shappell and Wiegmann, 2000

- ^ Wiegmann and Shappell, 2003

- ^ Reason, J. [1990] Human Error. Cambridge University Press